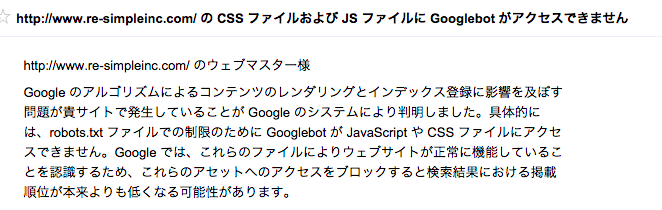

Googleウェブマスターツールから、急に「サイトエラー」の警告が送信された。

内容は、「CSS ファイルおよび JS ファイルに Googlebot がアクセスできません」というもの。

内容としては、かなり重要なものではありますが、アクセスを拒否している心当たりがないので、放っていても問題なさそうですが、いい機会なので、確認方法やGooglebotの設定方法をまとめておきます。

1. ブロックされているリソースを特定する

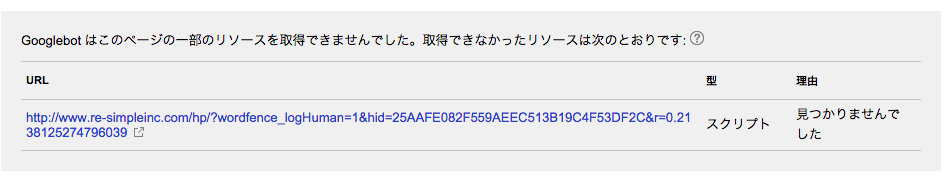

まずは、どのコンテンツが巡回エラーとなっているかの選別をします。

基本的に、「robots.txt」というファイルを作成して、クロールを拒否したりするのですが

そんなファイルを作成した記憶がない場合、Wordpressなどのプラグインで作成され、ある部分を自動的に巡回拒否している可能性があります。可能性としては、以下の可能性が考えられます。

1. robots.txtを作成して拒否設定している

2. robots.txtがプラグインなどで自動で作成された

3. robots.txtが作成されていない

1,2がの場合は、アクセスできない状態を回避すること、3の場合は新しく「robots.txt」を作成する必要があります。手法としては、ブロックしているリソースを検出するには、「Fetch as Google」機能を利用します。「Fetch as Google」機能を利用すると、robots.txt のディレクティブがブロックしているリソースを特定することができます。

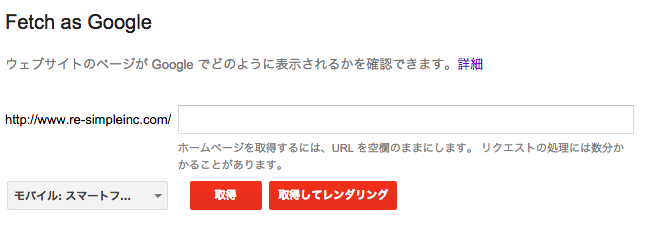

「Fetch as Google」ページで、トップディレクトリに対して

「取得してレンダリング」をクリックします。

デバイスを選択できますが、基本「PC」もしくは「モバイル」で問題ないと思います。

PC、モバイルで読み込むものが違う場合などは、双方ともに取得する必要があります。もしどっちにしようかなと迷う場合は、自分のサイトのアクセス数割合が多いほうを選択すれば問題ありません。PC、モバイルともに同じ情報を読み込むのであれば、結果は同じになります。

一定時間が過ぎれば、結果が表示されます。

全ての情報を取得できたのであれば「ステータス」が完了になります。

アクセスできなかったものがある場合は「一部」となります。

クリックすると、アクセスできなかったファイル名を表示できます。

ただし、毎回違う結果となる場合があり、実際のアクセス状況によって「完了」となる場合や、「一部」となる場合がある。

実際にプラグインなどの関係で拒否されている場合は、毎回同じ結果となるので、判断しやすいと思います。

2. robots.txt ファイルを更新する

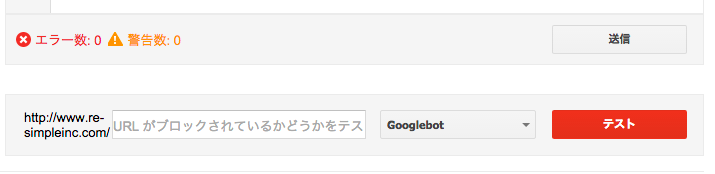

原因を確認したら、サイトの CSS や JavaScript ファイルの制限を robots.txt のディレクティブから削除します。そのために、一度「robots.txtテスター」ページに移動し、robots.txt テスターで変更をテストします。robots.txtページでは、現在、robots.txtが認識している情報が表示されます。

robots.txtが認識できているかの

テストを行うことができます。

robots.txtが拒否しているものなどが表示されます。

robots.txtの中身の書き方の基本は以下の通りです。

Sitemap:http://example.com/sitemap.xml

User-Agent:

これは、Googleクローラーの動きを制御するかを指定するものです。CSSなどの記述と同じく「*」は全てのクローラーに指示する設定です。ここに、指定をすると「Googlebot-image」などの画像用クローラーのみに指示することもできます。細かな設定は特に必要ありませんので、「*」で問題ありません。

Disallow:

これは、クローラーのアクセスを制御するファイルを指定する設定です。特定の URL またはパターンを入力できます。エントリはスラッシュ(/)で始める必要があります。例えば

サイト全体をブロックする

Disallow: /

特定のディレクトリとその中身をすべてブロックする

Disallow: /simple/

特定のページをブロックする

Disallow: /block.html

wordpressなどの場合、wp-admin内には入り込まないように

Disallow: /wp-admin/

と設定することがあります。

上記などの設定が完了したら、robots.txtをサーバーにアップします。

3. 「Fetch as Google」を使用して修正を検証する

[モバイル: スマートフォン] オプションを選択して、ページを取得してレンダリングし、スマートフォン用の Googlebot が正常にコンテンツをレンダリングすることを再度チェックします。問題がなければ、作業は終了です。

状態が「一部」になる場合は、再度確認をします。

ネット環境、サーバー環境によってエラーになる場合もあります。

robots.txtで拒否をしていない限りは基本問題ありません。

ウェブマスターツールは、今のサイト状況を確認できる非常に便利な機能があります。

警告なども、メールで知らせてくれるので、非常に優秀です。

ただ、とりあえず入れているだけという方も多いのも事実です。

今回のエラーのように、自分では気づいていないことを知らせてくれる便利なツールですので

ウェブマスターツールは、定期的にチェックをして、SEOやサイトの管理などに使ってみてください。